Kiến trúc Trích xuất Dữ liệu Từ Web bằng Rust cho Trích xuất Dữ liệu Có Thể Mở Rộng

Anh Tuan

Data Science Expert

TL;DR

- Gỡ mã web bằng Rust hoạt động tốt nhất khi việc lấy dữ liệu, phân tích cú pháp, hiển thị và lưu trữ được tách thành các lớp riêng biệt.

reqwestvàscraperđáp ứng nhiều mục tiêu tĩnh với chi phí tài nguyên thấp và dễ bảo trì hơn.- Gỡ mã bất đồng bộ với Tokio cải thiện lưu lượng cho các công việc phụ thuộc vào I/O, nhưng vẫn cần giới hạn tốc độ, thử lại và kiểm soát hàng đợi.

- Gỡ mã bằng trình duyệt không giao diện nên được sử dụng như một giải pháp dự phòng có chọn lọc cho các trang được hiển thị bằng JavaScript thay vì đường dẫn mặc định.

- Việc xử lý bảo vệ bot, xoay proxy và sự kiện CAPTCHA nên được thực hiện theo chính sách rõ ràng và thiết kế tự động hóa tuân thủ.

- Đối với các quy trình tự động hóa hợp pháp đáp ứng nhu cầu kinh doanh thực tế, CapSolver có thể được tích hợp vào lớp dự phòng hẹp bằng cách tuân theo luồng API chính thức của nó.

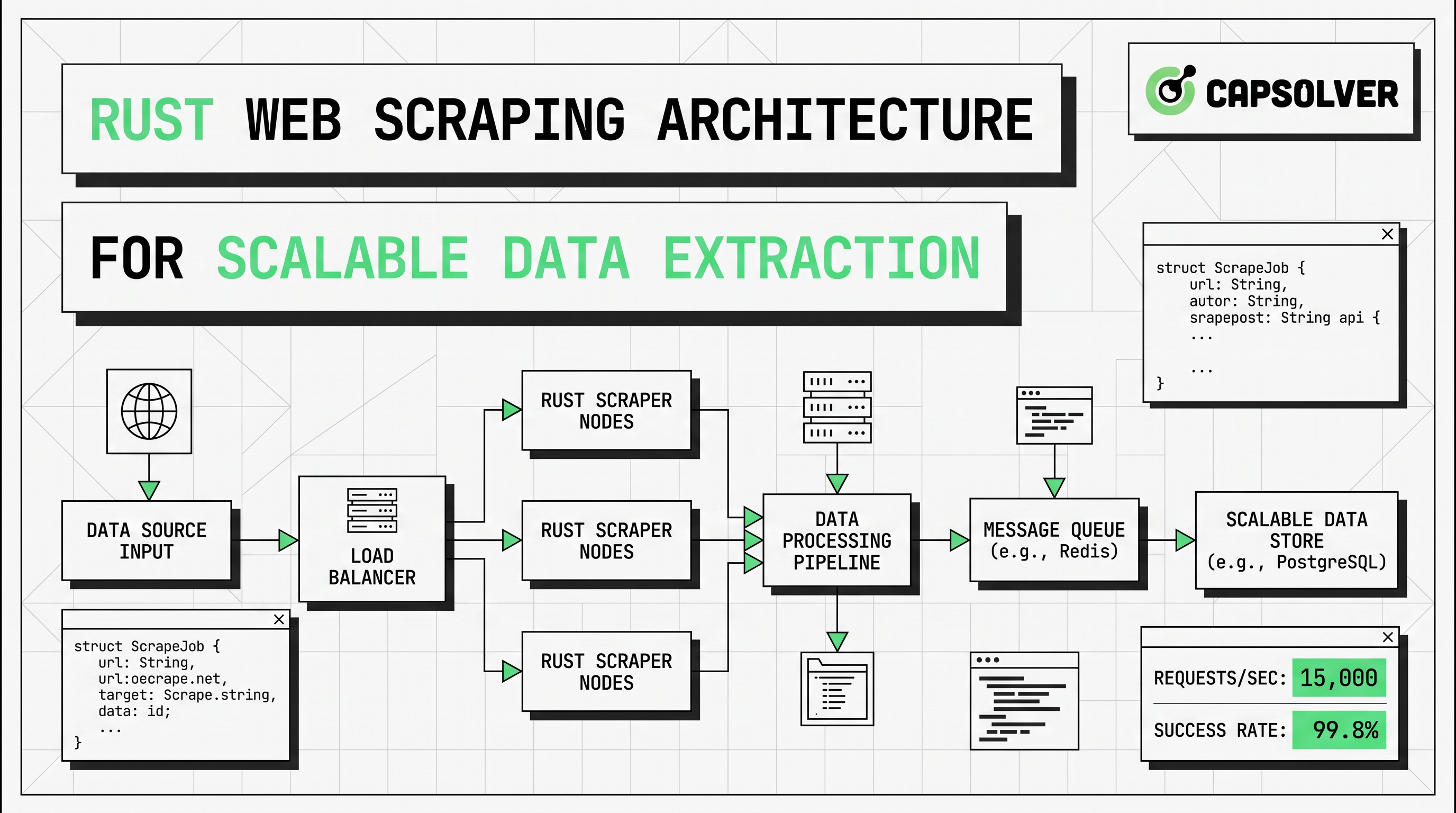

Gỡ mã web bằng Rust hiệu quả nhất khi được thiết kế như một kiến trúc, chứ không phải là một đoạn mã đơn lẻ. Bài viết này dành cho các kỹ sư, nhóm dữ liệu và người vận hành kỹ thuật cần trích xuất dữ liệu đáng tin cậy ở quy mô lớn. Kết luận chính đến trước: các hệ thống gỡ mã web bằng Rust tốt nhất giữ đường đi nhanh đơn giản với reqwest và scraper, sau đó chỉ thêm gỡ mã bất đồng bộ, gỡ mã bằng trình duyệt không giao diện, xoay proxy và xử lý thách thức khi mục tiêu thực sự yêu cầu chúng. Cấu trúc này giảm chi phí, cải thiện độ ổn định và giúp các luồng xử lý dài hạn dễ quan sát hơn.

Tổng quan về Gỡ mã Web Scraping bằng Rust

Gỡ mã web bằng Rust là lựa chọn mạnh mẽ cho các công việc trích xuất dữ liệu lớn vì nó kết hợp an toàn bộ nhớ với hiệu suất dự đoán được. Những đặc điểm này rất quan trọng khi một công nhân có thể xử lý hàng nghìn trang, phân tích cú pháp không ổn định và ghi lại các bản ghi được chuẩn hóa trong nhiều giờ.

Hầu hết các bài viết trong kết quả tìm kiếm hàng đầu giải thích cách lấy một trang và phân tích một lựa chọn. Thông tin này hữu ích, nhưng hiếm khi trả lời câu hỏi khó hơn. Kiến trúc gỡ mã web bằng Rust nên trông như thế nào khi bạn cần độ bền, khả năng quan sát và không gian mở rộng?

Một thiết kế sản xuất thường cần một lớp lấy HTTP, một lớp phân tích cú pháp, một nhánh hiển thị cho trang JavaScript, một lớp lưu trữ và một lớp vận hành cho thử lại, chỉ số và nhịp độ yêu cầu. Thứ tự đúng cũng rất quan trọng. Bắt đầu bằng phương pháp ít tốn kém nhất trước tiên. Lấy HTML thô. Chỉ phân tích các trường bạn cần. Chỉ nâng cấp lên gỡ mã bằng trình duyệt không giao diện khi HTML máy chủ không chứa dữ liệu mục tiêu. Chỉ thêm xoay proxy khi phân phối lưu lượng hoặc truy cập khu vực là cần thiết. Chỉ thêm xử lý CAPTCHA khi có lý do hợp pháp để tiếp tục trong quy trình tự động hóa.

Đối với các nhóm lập kế hoạch các giới hạn này, gỡ mã web và thu thập dữ liệu web giúp làm rõ phạm vi, và cách trích xuất dữ liệu có cấu trúc là tài liệu nội bộ hữu ích trước khi bắt đầu ánh xạ trường.

Thư viện Cốt lõi cho Gỡ mã Web bằng Rust

Gỡ mã web bằng Rust thường bắt đầu với ba khối xây dựng: reqwest, scraper và Tokio. Tài liệu chính thức reqwest mô tả reqwest là một client HTTP cấp cao với hỗ trợ bất đồng bộ, cookies, chuyển hướng, TLS và hỗ trợ proxy. Điều này khiến nó trở thành lớp vận chuyển thực tế cho gỡ mã web bằng Rust.

Tài liệu chính thức hướng dẫn Tokio bất đồng bộ giải thích tại sao futures và mô hình executor phù hợp với các công việc I/O có độ đồng thời cao. Điều này quan trọng vì gỡ mã web bằng Rust dành phần lớn thời gian chờ đợi máy chủ từ xa thay vì sử dụng CPU để tính toán trên thiết bị cục bộ.

Yêu cầu HTTP với reqwest

reqwest nên nằm trong lớp vận chuyển. Tái sử dụng một client duy nhất cho mỗi công nhân hoặc nhóm công nhân. Điều này giữ cho việc chia sẻ kết nối hiệu quả và cho phép bạn xác định các tiêu đề, thời gian chờ, cookies và chính sách proxy ở một nơi duy nhất.

rust

use reqwest::Client;

use scraper::{Html, Selector};

#[tokio::main]

async fn main() -> Result<(), Box<dyn std::error::Error>> {

let client = Client::builder()

.user_agent("Mozilla/5.0")

.build()?;

let html = client

.get("https://example.com")

.send()

.await?

.error_for_status()?

.text()

.await?;

let document = Html::parse_document(&html);

let card = Selector::parse("article")?;

for node in document.select(&card) {

println!("{}", node.text().collect::<Vec<_>>().join(" "));

}

Ok(())

}Mẫu này giữ cho gỡ mã web bằng Rust hiệu quả trên các trang tĩnh. Nó cũng làm cho việc xử lý lỗi dễ tiêu chuẩn hóa hơn. Kiểm tra trạng thái, ngân sách thử lại và nhật ký có cấu trúc có thể tất cả đều tồn tại xung quanh lớp yêu cầu thay vì bị trộn lẫn vào mã phân tích cú pháp.

Phân tích HTML với scraper

scraper nên nằm trong lớp phân tích cú pháp giữ nhỏ gọn và dễ kiểm tra. Không trộn các lựa chọn với logic mạng nếu bạn kỳ vọng các mẫu sẽ thay đổi. Một trình phân tích mạnh nhận HTML thô và trả về các bản ghi có kiểu, bản ghi một phần hoặc lỗi trích xuất rõ ràng.

Sự tách biệt này rất quan trọng vì sự thay đổi mẫu là phổ biến. Các lớp thay đổi. Văn bản di chuyển vào thuộc tính. Các nút trang trí xuất hiện giữa các phần tử mục tiêu. Trong gỡ mã web bằng Rust, việc tách biệt trình phân tích giúp các lỗi này hiển thị trong kiểm tra trước khi toàn bộ luồng bắt đầu ghi dữ liệu không đầy đủ.

Kiến trúc Gỡ mã Bất đồng bộ

Gỡ mã bất đồng bộ là lý do chính khiến gỡ mã web bằng Rust có thể mở rộng tốt trên cơ sở hạ tầng vừa phải. Runtime không khiến các trang web phản hồi nhanh hơn. Nó khiến các công nhân hiệu quả hơn khi nhiều yêu cầu đang chờ phản hồi mạng hoặc nguồn.

Một luồng gỡ mã web bằng Rust có thể mở rộng thường tuân theo cấu trúc dưới đây.

| Lớp | Vai trò | Mặc định Rust | Rủi ro chính |

|---|---|---|---|

| Bộ phân công | Chọn URL và ưu tiên | hàng đợi hoặc kênh | lưu lượng tăng đột biến |

| Bộ lấy dữ liệu | Gửi yêu cầu HTTP | reqwest::Client |

403, 429, thời gian chờ |

| Bộ phân tích | Trích xuất trường | lựa chọn scraper |

sự thay đổi mẫu |

| Bộ hiển thị | Tải trang JavaScript | gỡ mã bằng trình duyệt không giao diện | chi phí CPU và bộ nhớ |

| Lớp thách thức | Xử lý các sự kiện CAPTCHA được phép | nhánh dự phòng CapSolver | loại nhiệm vụ sai |

| Lưu trữ | Ghi đầu ra được chuẩn hóa | JSON, CSV, DB | không khớp lược đồ |

| Khả năng quan sát | Theo dõi sức khỏe và chất lượng | nhật ký, theo dõi, chỉ số | mất dữ liệu âm thầm |

Quy tắc thiết kế chính là nâng cấp có chọn lọc. Bắt đầu mọi mục tiêu bằng phương pháp ít tốn kém nhất. Nếu HTML trả về chứa dữ liệu, hãy tiếp tục với reqwest và scraper. Nếu các trường mục tiêu chỉ xuất hiện sau khi làm đầy, hiển thị phía client hoặc sự kiện trình duyệt, hãy định tuyến loại trang này đến gỡ mã bằng trình duyệt không giao diện. Nếu các kiểm soát bảo vệ bot hoặc CAPTCHA xuất hiện trong quy trình được phê duyệt, hãy xem xét chính sách mạng, hành vi trình duyệt và yêu cầu nhánh dự phòng cùng nhau thay vì sửa từng phần một.

Đây là nơi nhiều hệ thống trở nên lãng phí. Các nhóm mặc định sử dụng tự động hóa trình duyệt cho mọi yêu cầu. Điều này làm tăng chi phí, giảm đồng thời và khiến các lỗi khó phân loại hơn. Báo cáo Trạng thái JavaScript của HTTP Archive cho thấy các trang hiện đại vẫn phụ thuộc nhiều vào JavaScript, với kích thước chuyển giao JavaScript trung bình trên máy tính để bàn là 803,3 KB và 23 yêu cầu script bên ngoài trong chế độ xem báo cáo được chọn. Điều này giải thích tại sao một số mục tiêu cần hiển thị, nhưng không biện minh cho việc sử dụng trình duyệt cho mọi trang.

Xử lý Trang Được Hiển thị bằng JavaScript

Gỡ mã bằng trình duyệt không giao diện là cần thiết khi dữ liệu được tạo ra sau phản hồi HTML ban đầu. Các tín hiệu phổ biến bao gồm HTML máy chủ trống, nội dung được chèn sau khi làm đầy, danh sách cuộn vô hạn hoặc các trang chỉ hiển thị trường sau tương tác người dùng.

Gỡ mã web bằng Rust nên xem việc hiển thị trình duyệt là một nhánh riêng biệt thay vì cơ sở chung. Sử dụng nó cho lưới sản phẩm được lấp đầy sau yêu cầu phía client, bảng điều khiển được hiển thị trong trình duyệt hoặc giao diện nơi nội dung quan trọng bị ẩn sau các logic nhấp chuột và cuộn. Giữ bộ pool trình duyệt nhỏ và tách biệt nó khỏi các công nhân HTTP bất đồng bộ chính.

Một quy tắc quyết định thực tế đơn giản. Nếu dữ liệu có sẵn trong HTML thô, hãy tiếp tục với reqwest và scraper. Nếu các trường chỉ xuất hiện sau khi thực thi JavaScript, hãy chuyển hướng đến gỡ mã bằng trình duyệt không giao diện. Nếu cùng một mục tiêu cũng áp dụng các kiểm soát bảo vệ bot, hãy xem xét chính sách mạng, hành vi trình duyệt và yêu cầu nhánh dự phòng cùng nhau thay vì sửa từng phần một.

Đối với tài liệu nội bộ liên quan, tự động hóa trình duyệt cho nhà phát triển và tự động hóa giải CAPTCHA trong trình duyệt không giao diện vừa vặn tự nhiên vào mô hình có lớp này.

CAPTCHA và Hạn Chế Gỡ Mã

Gỡ mã web bằng Rust luôn có giới hạn. Một số là kỹ thuật. Một số là pháp lý hoặc vận hành. Phần kỹ thuật bao gồm danh tiếng IP, xử lý phiên, kiểm tra dấu vân tay trình duyệt, API ẩn và bảo vệ bot nhiều lớp. Phần vận hành bao gồm nhịp độ yêu cầu, ngân sách lỗi và tác động của lưu lượng đến trang đích.

Đó là lý do tại sao tuân thủ phải được tích hợp vào kiến trúc. Hướng dẫn robots.txt của Google Search Central giải thích rằng robots.txt chủ yếu được sử dụng để quản lý lưu lượng crawler và tránh làm quá tải trang. Điểm này rất quan trọng đối với gỡ mã web bằng Rust vì một hệ thống được thiết kế tốt không chỉ cố gắng trích xuất dữ liệu. Nó cũng cố gắng kiểm soát tải, giảm các yêu cầu không cần thiết và giữ hành vi thu thập hợp lý.

Khi các quy trình tự động hợp pháp gặp các bước CAPTCHA, CapSolver là dịch vụ dự phòng tập trung phù hợp. Cách tiếp cận an toàn nhất là tuân theo tài liệu chính thức thay vì tạo định dạng yêu cầu tùy chỉnh. Tài liệu createTask của CapSolver cho thấy mẫu thân thể yêu cầu tiêu chuẩn dưới đây.

json

POST https://api.capsolver.com/createTask

Host: api.capsolver.com

Content-Type: application/json

{

"clientKey":"YOUR_API_KEY",

"appId": "APP_ID",

"task": {

"type":"ImageToTextTask",

"body":"BASE64 image"

}

}Luồng chính thức tương tự trả về taskId cho các nhiệm vụ bất đồng bộ, sau đó nên được kiểm tra thông qua getTaskResult. Trong hệ thống gỡ mã web bằng Rust có thể mở rộng, logic thách thức này nên ở ngoài luồng lấy dữ liệu và phân tích thông thường để các yêu cầu bình thường vẫn nhanh và dễ theo dõi.

Nhận Mã Giảm Giá CapSolver của Bạn

Tăng ngay ngân sách tự động hóa của bạn!

Sử dụng mã giảm giá CAP26 khi nạp tiền tài khoản CapSolver của bạn để nhận thêm 5% tiền thưởng cho mỗi lần nạp — không giới hạn.

Nhận mã giảm giá ngay bây giờ trong Bảng điều khiển CapSolver

Mở Rộng Gỡ Mã Web bằng Rust cho Thu Thập Dữ Liệu Quy Mô Lớn

Mở rộng gỡ mã web bằng Rust chủ yếu là về kiểm soát, không phải khối lượng mã. Kiến trúc nên áp dụng kiểm soát theo từng miền, giới hạn thử lại, ngân sách thời gian chờ và kiểm tra đầu ra. Không có các kiểm soát này, các công nhân nhanh hơn chỉ tạo ra các lỗi nhanh hơn.

Xoay proxy nên nằm trong lớp vận chuyển thay vì lớp phân tích. Sử dụng nó khi yêu cầu cần phân phối qua các địa chỉ IP để cân bằng tốc độ, truy cập khu vực hoặc tách biệt khối lượng công việc. Giữ chính sách cụ thể. Xoay theo miền, lớp đầu cuối hoặc loại khối lượng công việc. Tránh xoay proxy ngẫu nhiên phá vỡ liên tục phiên và thêm tiếng ồn vào việc gỡ lỗi.

Đây cũng là nơi các tài nguyên hỗ trợ nội bộ trở nên hữu ích. Dịch vụ proxy tốt nhất có thể giúp đánh giá chiến lược mạng, trong khi luật pháp gỡ mã web là một điểm kiểm tra nội bộ hữu ích trước khi mở rộng khối lượng thu thập.

Các hệ thống gỡ mã web bằng Rust mạnh nhất cũng đo chất lượng trích xuất trực tiếp. Theo dõi tỷ lệ thành công, tỷ lệ trường trống, sự thay đổi mẫu, tỷ lệ hiển thị, độ trễ lấy dữ liệu trung bình và chi phí cho mỗi bản ghi thành công. Các chỉ số này cho thấy khi đường đi HTML thô vẫn đủ và khi gỡ mã bằng trình duyệt không giao diện, xoay proxy hoặc xử lý thách thức trở nên quá đắt đỏ.

Tóm tắt So sánh

| Phương pháp | Trường hợp sử dụng tốt nhất | Hồ sơ chi phí | Hồ sơ độ tin cậy | Ghi chú |

|---|---|---|---|---|

reqwest + scraper |

trang tĩnh hoặc ít động | thấp | cao khi các lựa chọn ổn định | đường dẫn mặc định tốt nhất cho gỡ mã web bằng Rust |

| Gỡ mã bất đồng bộ với công nhân Tokio | nhiều URL phụ thuộc vào I/O | thấp đến trung bình | cao với giới hạn tốc độ | cải thiện lưu lượng, không cải thiện chất lượng trình phân tích |

| Gỡ mã bằng trình duyệt không giao diện | trang được hiển thị bằng JavaScript | cao | trung bình | tách biệt nó trong một nhóm nhỏ |

| Xoay proxy | kiểm soát tốc độ phân phối và truy cập khu vực | trung bình | trung bình | hữu ích khi danh tính lưu lượng quan trọng |

| Nhánh dự phòng CapSolver | sự kiện CAPTCHA được phép trong quy trình tự động hóa | theo sự kiện | trung bình đến cao | giữ cho triển khai đồng bộ với tài liệu chính thức |

Kết luận

Gỡ mã web bằng Rust mở rộng khi kiến trúc giữ được sự chọn lọc. Sử dụng reqwest và scraper cho đường đi nhanh. Thêm gỡ mã bất đồng bộ khi bạn cần nhiều lưu lượng hơn cho các công việc phụ thuộc vào mạng. Dành riêng gỡ mã bằng trình duyệt không giao diện cho các trang thực sự cần hiển thị. Giữ xoay proxy và xử lý thách thức như các lớp dự phòng được kiểm soát. Thiết kế này giữ chi phí thấp hơn, cải thiện khả năng quan sát và làm cho việc bảo trì trình phân tích dễ dàng hơn nhiều.

Nếu luồng hiện tại định tuyến mọi trang qua trình duyệt, cải tiến sạch sẽ thường là một sự phân chia đường đi. Di chuyển các mục tiêu tĩnh trở lại HTTP đơn giản. Giữ các trang JavaScript trong nhánh hiển thị nhỏ hơn. Giữ logic thách thức tách biệt. Thay đổi này thường cải thiện cả độ tin cậy và kinh tế đơn vị.

Câu hỏi Thường Gặp

Gỡ mã web bằng Rust có tốt hơn Python cho các công việc lớn không?

Gỡ mã web bằng Rust thường là lựa chọn mạnh mẽ khi độ ổn định lâu dài, đồng thời và an toàn bộ nhớ là quan trọng nhất. Python vẫn có hệ sinh thái gỡ mã rộng hơn, nhưng Rust hấp dẫn khi hiệu suất công nhân và hiệu suất dự đoán là ưu tiên chính.

Khi nào tôi nên chuyển từ reqwest sang gỡ mã bằng trình duyệt không giao diện?

Chuyển chỉ khi HTML máy chủ không chứa các trường bạn cần. Nếu dữ liệu mục tiêu xuất hiện sau khi làm đầy, sự kiện phía client hoặc yêu cầu API bị trì hoãn, gỡ mã bằng trình duyệt không giao diện trở nên hợp lý.

Gỡ mã bất đồng bộ giúp gì trong Rust?

Gỡ mã bất đồng bộ giúp gỡ mã web bằng Rust xử lý nhiều yêu cầu đang chờ đợi với ít tài nguyên bị lãng phí hơn. Nó cải thiện lưu lượng cho công việc phụ thuộc vào I/O, nhưng vẫn cần giới hạn tốc độ, logic thử lại và kiểm tra trình phân tích.

Tôi luôn cần xoay proxy không?

Không. Nhiều công việc hoạt động tốt mà không cần nó. Việc quay vòng proxy quan trọng khi bạn cần truy cập khu vực, phân phối lưu lượng theo miền, hoặc giảm sự tập trung từ một phạm vi IP duy nhất.

Tôi nên xử lý trang CAPTCHA trong luồng công việc tuân thủ như thế nào?

Giữ việc xử lý CAPTCHA hẹp, được tài liệu hóa và tách biệt khỏi đường dẫn fetch thông thường. Nếu một luồng công việc tự động hóa hợp lệ yêu cầu điều đó, hãy sử dụng luồng nhiệm vụ CapSolver chính thức và đảm bảo triển khai nhất quán với tài liệu đã công bố.

Xem thêm

web scrapingFeb 17, 2026

Cách giải CAPTCHA trên Nanobot bằng CapSolver

Tự động hóa việc giải CAPTCHA với Nanobot và CapSolver. Sử dụng Playwright để giải reCAPTCHA và Cloudflare tự động.

web scrapingFeb 10, 2026

Dữ liệu dưới dạng dịch vụ (DaaS): Nó là gì và tại sao nó quan trọng vào năm 2026

Hiểu về Dịch vụ Dữ liệu (DaaS) vào năm 2026. Khám phá lợi ích, trường hợp sử dụng và cách nó thay đổi doanh nghiệp với phân tích thời gian thực và tính mở rộng.